Dans un environnement digital de plus en plus concurrentiel, les tests A/B, ou A/B testing, s’impose comme une méthode incontournable pour optimiser l’expérience utilisateur et maximiser les performances de votre site web. En effet, cette approche scientifique permet d’augmenter significativement les taux de conversion, d’améliorer la satisfaction des utilisateurs et d’éclairer les décisions marketing grâce à des données concrètes, en se basant sur la comparaison de différentes versions des éléments d’une page, par exemple.

Face à la complexité croissante des enjeux UX/UI, l’accompagnement d’experts comme Arquen devient essentiel pour exploiter pleinement le potentiel de cette pratique, y compris pour une application mobile. Découvrez donc dans cet article les bases de l’A/B testing, ainsi que les raisons de choisir Arquen pour vos tests.

Qu’est-ce que l’A/B testing et pourquoi est-il indispensable en UX/UI ?

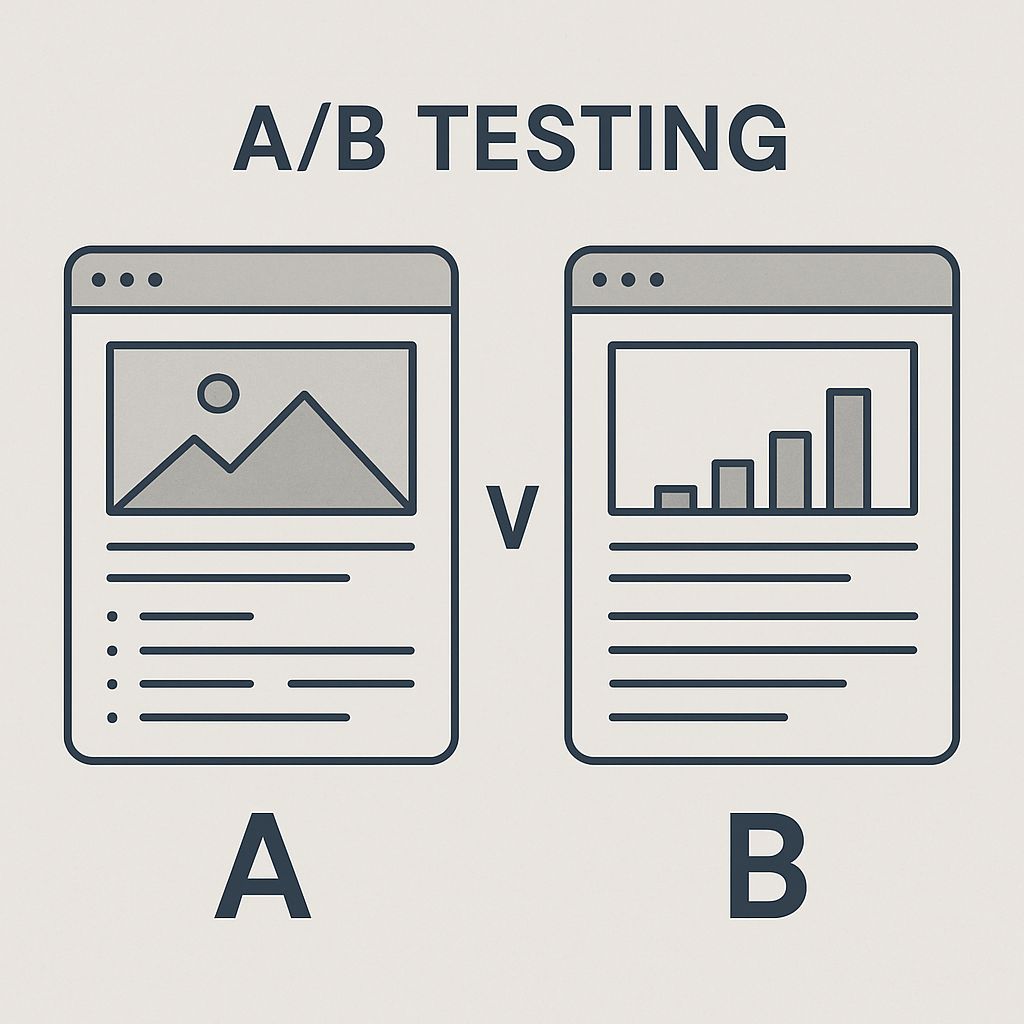

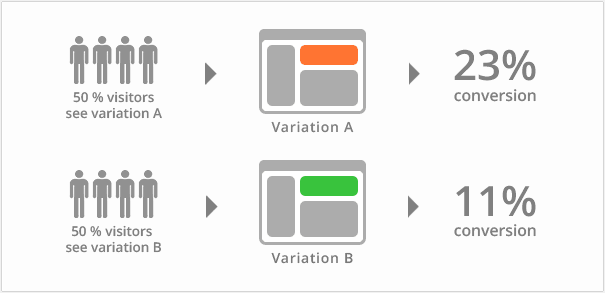

Schéma explicatif d’un test AB. Source : Christian posta

L’A/B Testing est une technique de web-marketing qui consiste à proposer deux versions d’un même page afin de déterminer la version qui donne les meilleurs résultats, afin de déterminer la version qui donne les meilleurs résultats auprès des consommateurs. Ce sera par exemple la mise en place simultanée de deux pages d’accueil différentes, pour voir laquelle génère le plus de contacts (mail/achat/téléchargement, etc.) ou de ventes. Ces 2 pages peuvent avoir beaucoup ou très peu d’éléments différents : ce pourra être uniquement un argument de vente modifié, la position d’un bouton d’action ou bien un design complètement revu.

Les tests sont réalisés à l’aide d’une solution technique, souvent en mode SaaS (Software as a Service, c’est-à-dire disponible uniquement en ligne), qui redirigera les utilisateurs sur les différentes versions selon l’affluence désirée.

On scinde les visiteurs en deux groupes (d’où le nom A/B), on leur affiche une version de page différente, puis on suit le parcours des deux groupes en temps réel, et on regarde laquelle des deux donne le meilleur résultat par rapport à un objectif donné, notamment en termes de taux de conversion.

Les solutions les plus célèbres d’AB testing sont :

- AB Tasty

- Kameleoon (Arquen est un partenaire certifié)

- Optimizely

- Visual Website Optimizer

Le processus d’A/B testing se démocratise de plus en plus et à fait ses preuves pour améliorer le taux de transformation de son site web.

Une technique de plus en plus répandue est aussi le test multivarié ou MVT. Il permet de faire varier plusieurs éléments ou objets d’une même page et d’analyser quelle combinaison convertit le plus. Par exemple, vous pourrez tester sur un même test A/B, deux versions du bouton de mise au panier de votre fiche produit, deux version de votre call to action, 4 titres différents, 4 images différentes, et analyser laquelle des combinaisons « bouton-titre-image » est la plus adaptée pour votre site internet.

Ces pages sont affichées aux différents utilisateurs de manière équitable ou non, avec un système de redirection partielle. Leurs résultats sont constatés à postériori via l’utilisation d’outils d’analyse. On pourra comparer toutes les données qui diffèrent entre les pages : taux de rebond, temps de connexion, taux de transformation…

Après de nombreux tests, on peut affiner ses arguments marketing et son ergonomie pour obtenir la page la plus efficace possible. Il est possible de réaliser des test A/B sur un plus grand nombre de pages. Attention cependant à avoir assez de trafic pour que les chiffres obtenus soient significatifs : la confiance statistique doit être supérieure à 95%.

Il existe aussi les tests « multipages » où l’on teste un parcours, c’est à dire une variation sur plusieurs pages ou plusieurs variations sur plusieurs pages. Cela peut être par exemple l’ajout d’éléments de réassurance à différents endroits sur le parcours d’achat (du panier au paiement).

Origine et évolution de l’A/B testing : des géants du web aux entreprises françaises

Les origines de l’A/B testing remontent à des expérimentations de Google. En 2000, le géant de la Silicon Valley a conduit son premier test puis n’a fait qu’essayer de démocratiser la pratique. En 2011, Google avait lancé plus de 7 000 tests A/B sur l’ utilisation de son algorithme de recherche. Amazon, Netflix et eBay lui ont emboîté le pas et sont également devenu pro-actifs dans le testing de leurs sites et nouveautés. On parle souvent de « la page d’accueil » de Google ou d’Amazon, mais il serait plus exact de parler d’« une » des pages d’accueil de Google ou Amazon, tellement un grand nombre de tests est constamment en train d’être réalisé.

Cela crée l’émergence d’un web « testable », bien plus sécuritaire pour les entreprises, aucun choix n’est difficile ni irréversible, il n’y a plus de refonte complète d’un site, mais des optimisations constantes de celui-ci. Cela permet de limiter le risque et surtout d’apporter des réponses prouvées par des chiffres et donc indiscutables.

Le saviez-vous ?

|

Les avantages concrets d’une stratégie d’A/B testing

L’utilisation de l’A/B testing peut offrir des avantages tangibles qui se traduisent directement par des améliorations mesurables des performances de votre page web.

- Optimisation du taux de clics et de conversion : Cette méthode permet d’identifier précisément les éléments qui incitent les utilisateurs à agir. Par exemple, les tests sur les couleurs des boutons d’appel à l’action révèlent des différences significatives : les boutons rouges peuvent augmenter les conversions de 21% par rapport aux boutons verts, tandis que les boutons orange génèrent souvent les meilleurs résultats.

- Réduction des risques liés aux modifications UX : L’A/B testing permet de valider les changements avant leur déploiement complet, évitant ainsi les erreurs coûteuses. Cette approche garantit que chaque modification apporte une amélioration réelle plutôt qu’une dégradation de l’expérience utilisateur.

- Prise de décisions basée sur des données fiables : Plutôt que de s’appuyer sur l’intuition, l’A/B testing fournit des données statistiquement significatives pour éclairer les décisions. Cette approche data-driven élimine les biais personnels et les suppositions, permettant une optimisation continue basée sur des faits.

- Personnalisation des contenus pour chaque segment d’audience : L’A/B testing permet de comprendre les préférences spécifiques de différents segments d’utilisateurs et d’adapter l’expérience en conséquence. Cette personnalisation améliore l’engagement et les taux de conversion.

Cas pratique : Comment Distingo a augmenté ses ventes grâce à l’A/B testing

Nous avons accompagné notre client Distingo Bank sur plus de 20 A/B tests afin d’optimiser son taux de conversion (leads).

Avec plus de 30 tests réalisés sur une période de 2 ans, nous avons travaillé la majorité de chantiers UX afin d’améliorer la performance globale de +67% de conversion !

Les chantiers ont porté sur les sujets suivants:

- Menu de navigation

- Optimisation des CTA

- Messages de réassurance, test de différentes thématiques

- Push

- Mise en avant des partenaires

- Tests UI de mise en avant du taux et des USP

- Optimisation du tunnel de souscription

Bon à savoir : Conditions pour réussir un test A/B

|

Comment mettre en place efficacement un A/B test : les étapes clés

Pour réaliser un plan de test, on définit les 2 types d’objectifs principaux de la performance :

- Primaire : indicateur qui décidera in fine de la généralisation ou non du test (souvent le taux de conversion).

- Secondaire : indicateur sur lequel on doit rester vigilant (souvent des indicateurs d’engagement comme le temps passé, le taux de rebond…).

Une fois les objectifs principaux définis, on analyse les pages de destination les plus importantes, leurs messages marketing, fonctionnalités, arguments… Pour trouver les idées de test.

Le plan de test comprendra les éléments de cadrage suivants :

- Indicateurs de performance (primaires et secondaires)

- Méthodologie (A/B, MVT et pages concernées)

- Nombre de versions alternatives à tester

- Échantillonnage entre les versions (par exemple: 20% du trafic sur A et 80% sur B)

- Durée du test estimée (selon des modèles statistiques prédictifs)

- Spécifications pour le suivi des résultats

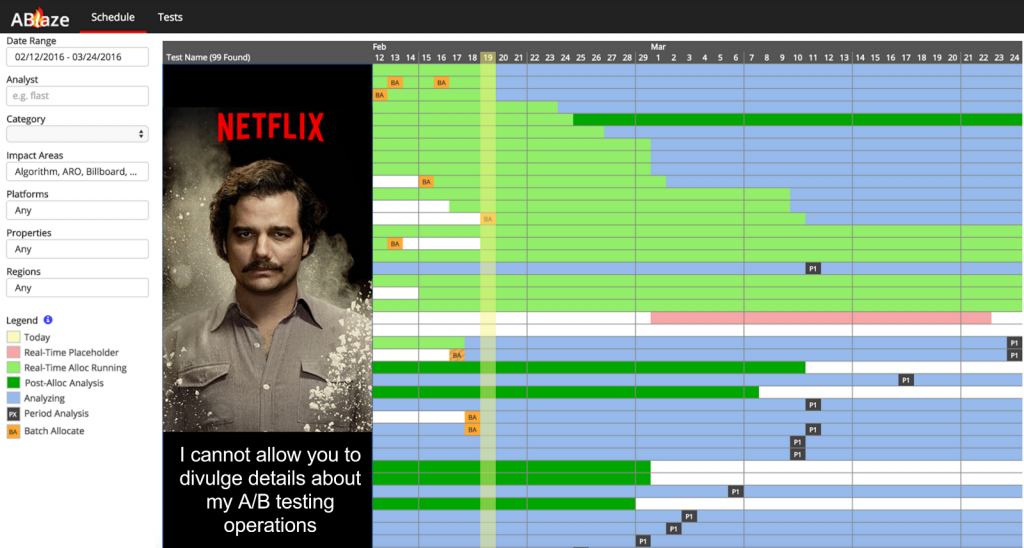

Voici le planning d’optimisation d’une des références en la matière, Netflix :

Planning utilisé par Netflix pour coordonner ses A/B tests. Source : Netflix

Checklist complète pour réussir votre A/B test

Définition des objectifs

- Identifier la métrique principale à optimiser (conversion, clics, temps passé)

- Définir les objectifs secondaires et les contre-métriques à surveiller

- Fixer le seuil de significativité statistique (généralement 95%)

Choix des variantes à tester avec les tests a/b

- Formuler une hypothèse claire et testable à grande échelle

- Créer une variation qui ne diffère que par un élément

- S’assurer que les variations sont techniquement réalisables

Répartition du trafic d’une page ou d’un site

- Calculer la taille d’échantillon nécessaire

- Configurer la répartition aléatoire du trafic (généralement 50/50)

- Exclure les utilisateurs non concernés par le test

Suivi et analyse des résultats de l’a/b test

- Surveiller les métriques en temps réel sans arrêter prématurément

- Vérifier l’absence de biais techniques (Sample Ratio Mismatch)

- Analyser les résultats par segments d’audience

- Calculer la significativité statistique et l’effect size

Les erreurs courantes à éviter absolument lors d’un test ab

L’A/B testing, malgré sa simplicité apparente, aide à prendre des décisions, mais présente tout de même de nombreux pièges qui peuvent compromettre la validité des résultats. L’erreur la plus fréquente consiste à inclure dans l’expérience des utilisateurs qui ne sont pas affectés par le changement testé, diluant ainsi les résultats.

L’arrêt prématuré du test représente une autre erreur critique. Beaucoup d’entreprises interrompent leurs tests dès qu’elles observent des résultats encourageants, sans attendre la significativité statistique nécessaire pour chaque object. En effet, cette pratique peut conduire à des conclusions erronées et à l’implémentation de changements qui ne sont pas réellement efficaces.

La modification simultanée de plusieurs éléments constitue également un piège majeur. Cette approche rend impossible l’identification de l’élément responsable de l’amélioration ou de la dégradation des performances.

Attention : biais statistiques à éviter

|

Test A/B, Split testing ou Test multivarié : Quelle méthode choisir pour prendre des décisions ?

Le choix de la méthode de test dépend de vos objectifs, de votre trafic et de la complexité des changements qu’il est possible de tester.

- L’A/B testing classique convient parfaitement pour comparer deux versions simples d’un élément. Cette méthode est idéale pour tester un changement de couleur, de texte ou de positionnement d’un élément spécifique. Elle nécessite moins de trafic et fournit des résultats plus rapides.

- Le split testing s’impose lorsque les changements sont importants et nécessitent des URL distinctes. Cette approche est recommandée pour tester des designs radicalement différents ou des parcours utilisateurs complètement repensés.

- Les tests multivariés permettent d’optimiser plusieurs variables simultanément en testant toutes les combinaisons possibles. Cette méthode est plus complexe et nécessite un trafic important pour obtenir des résultats statistiquement significatifs, mais elle permet d’identifier les meilleures combinaisons d’éléments.

| Méthode | Avantages | Contraintes | Cas d’usage |

| A/B Testing | Simple à mettre en œuvre, résultats rapides | Un seul élément testé | Changements ponctuels (couleur, texte) |

| Split Testing | Permet des changements majeurs | Nécessite des URL séparées | Refonte complète de pages |

| Test Multivarié | Optimisation globale | Trafic important requis | Optimisation simultanée de plusieurs éléments |

Outils et solutions pour réaliser vos tests A/B

Le marché des outils d’A/B testing propose plusieurs solutions performantes, chacune avec ses spécificités.

- AB Tasty se distingue par sa plateforme complète d’expérimentation et de personnalisation, incluant des capacités d’intelligence artificielle avancées avec EmotionsAI. La solution offre des performances optimisées avec un script qui se charge jusqu’à 4 fois plus rapidement que certains concurrents.

- Kameleoon propose une plateforme unifiée combinant expérimentation web et feature flags, avec des fonctionnalités avancées de précision des données et de conformité RGPD. L’outil se caractérise par sa rapidité d’exécution et son absence de scintillement (flicker-free).

- Optimizely reste une référence historique du marché, offrant des solutions et fonctionnalités robustes pour les entreprises de toutes tailles. La plateforme excelle dans la gestion des tests complexes et l’intégration avec les systèmes existants.

Cependant, la maîtrise technique de ces outils ne suffit pas. L’accompagnement UX d’une agence spécialisée comme Arquen répond à un besoin crucial pour maximiser le ROI de vos tests. Cette expertise permet d’éviter les erreurs coûteuses, d’optimiser la stratégie de test pour l’application mobile et d’interpréter correctement les résultats.

Fonctionnalités clés à rechercher dans un outil d’A/B testing

- Interface intuitive avec éditeur visuel WYSIWYG

- Capacités de segmentation avancée des audiences

- Reporting en temps réel avec analyses statistiques

- Intégrations natives avec les outils analytics existants

- Conformité RGPD et gestion des données personnelles

- Support technique et accompagnement à la mise en œuvre

Mesurer et exploiter les résultats d’un test A/B

L’analyse rigoureuse des résultats est l’étape cruciale de tout test A/B. Une interprétation précise des données garantit la validité des conclusions et l’efficacité des optimisations futures.

Trois critères de succès essentiels doivent être surveillés :

- Hausse du taux de conversion : Cette métrique centrale indique directement l’amélioration de la performance commerciale du site ou de l’application.

- Baisse du taux de rebond : Ce critère révèle une meilleure rétention des visiteurs et un engagement utilisateur renforcé.

- Augmentation du temps passé : Cet indicateur démontre un intérêt accru des visiteurs pour le contenu proposé.

Pour des décisions véritablement éclairées, l’analyse doit s’appuyer sur une significativité statistique d’au moins 95% de confiance.

Interpréter les résultats : exemple concret d’un rapport A/B

Une fois les résultats obtenus, il est conseillé de partager les résultats par e-mail au plus grand nombre au sein de votre entreprise : vos collaborateurs apprécieront cette approche pragmatique, et les résultats positifs sont toujours un élément de motivation dans une structure.

Cependant, deux écueils sont souvent rencontrés :

- Une campagne qui s’éternise (trop de tests à faire et pas assez de volume significatif)

- Des résultats impossibles à analyser : mauvaise remontée dans l’interface, il faut bien anticiper le tracking.

Les résultats sont ensuite présentés dans ce type de tableau, pour déterminer la version gagnante:

| Visites | Taux de rebond | Pages/session | Temps d’une session moyenne | ||||

| A | 15 012 | 13,62% | – | 10,57 | + 6,45% | 06:50 | + 5,15% |

| B | 14 098 | 13,10% | – 3,82% | 9,93 | – | 06:30 | – |

| Valeur par visite | Panier moyen | Taux de conversion | ||||

| A | 13,28 € | +8,55 % | 248,31€ | + 0,44% | 5,35% | + 8,08% |

| B | 12,24 € | – | 247,21€ | – | 4,95% | – |

Exemple d’un tableau de résultats d’un test A/B

Le ciblage et la segmentation permettent de présenter les différents tests aux utilisateurs de différentes typologies; créés à partir de données disponibles sur les visiteurs (source, statut, device, langue, etc.), on peut tester des expériences personnalisées à chaque segment de visiteurs et ainsi maximiser les chances de conversion pour l’audience et es différents profils de visiteurs. Ces tests « ciblés » nécessitent cependant d’avoir un trafic suffisant sur chacun des segments de visiteurs testés.

Pourquoi choisir Arquen pour votre stratégie d’ A/B testing ?

Face à la complexité croissante de l’optimisation des expériences utilisateurs, l’accompagnement expert devient un facteur clé de succès, y compris pour les réseaux sociaux. Un consultant Arquen se distingue par son approche sur mesure qui combine expertise technique et vision stratégique UX/UI.

- L’expérience dans la gestion de projets UX complexes d’Arquen permet d’aborder l’A/B testing avec une vision holistique de l’expérience utilisateur. Cette approche dépasse la simple optimisation de métriques pour créer des expériences cohérentes et engageantes qui servent réellement les objectifs de votre marque.

- La méthodologie rigoureuse et flexible développée par Arquen s’adapte aux spécificités de chaque secteur d’activité et de chaque contexte business. Cette adaptation garantit des résultats pertinents et exploitables, évitant les écueils des approches génériques.

- La capacité à délivrer des résultats concrets rapidement repose sur une maîtrise complète de la chaîne de valeur de l’A/B testing : de l’audit initial à l’implémentation des optimisations, en passant par la conception des tests et l’analyse des résultats.

Et l’accompagnement Arquen ne se limite pas à l’aspect technique. En effet, notre agence apporte une expertise en UX Research et en conception orientée conversion qui transforme chaque test en opportunité d’apprentissage et d’amélioration continue.

| À noter : L’équipe Arquen permet d’identifier les leviers d’optimisation les plus pertinents avant même de lancer les tests. Cette approche préventive maximise le ROI de chaque expérience et accélère l’atteinte des objectifs de conversion. |

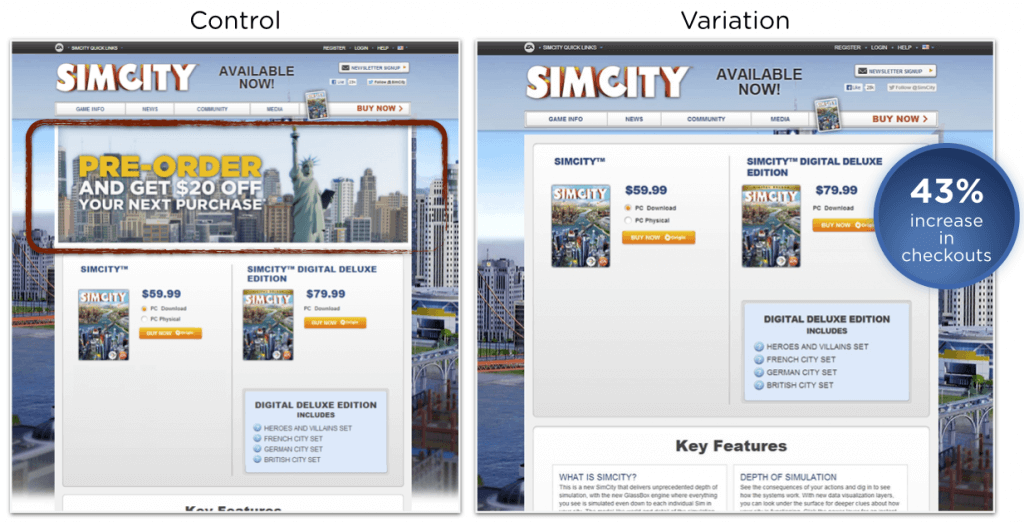

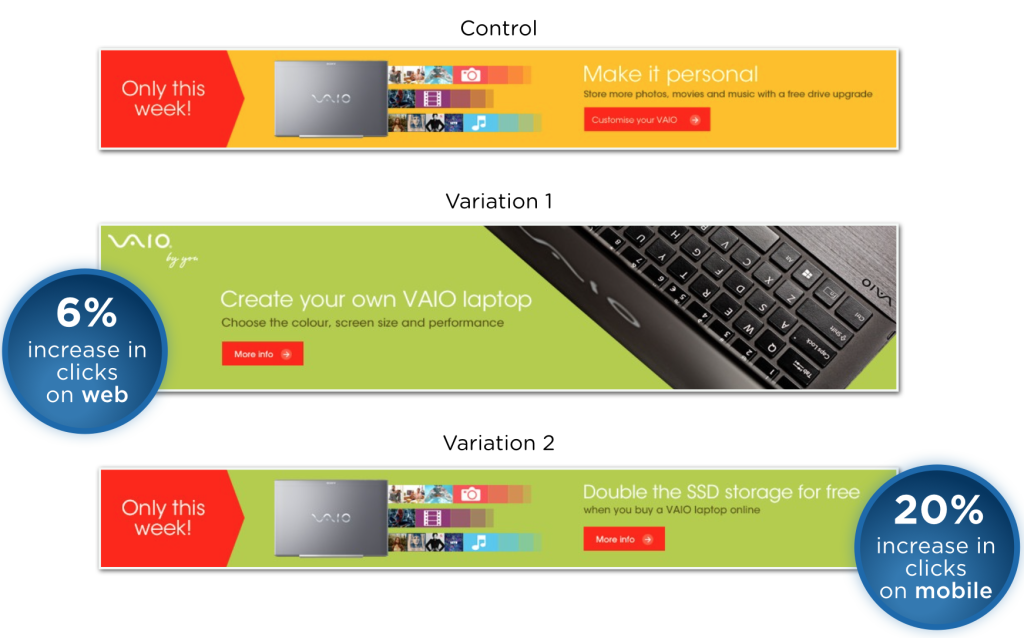

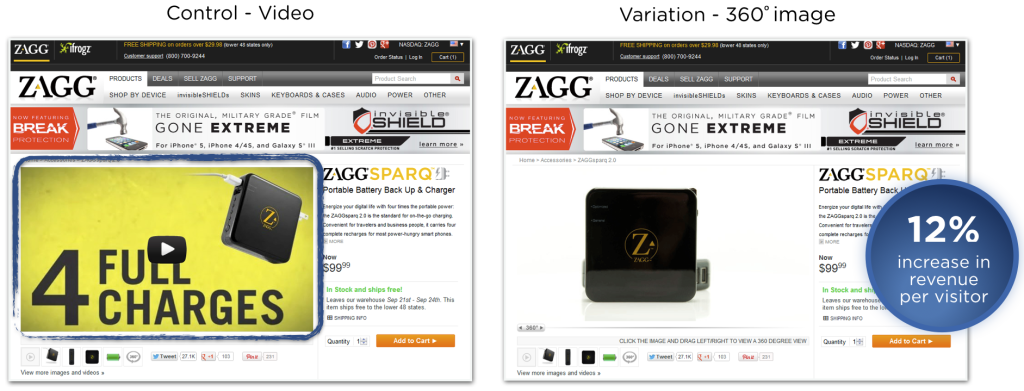

Quelques exemples d’A/B tests

- Electronic arts – Vente de Sim City

Source : Optimizely

- Sony Vaio – Bannières promotionnelles

Source : Optimizely

- ZAGG – Page produit

Source : Optimizely

Conclusion

L’A/B testing s’impose aujourd’hui comme un pilier incontournable de l’optimisation UX/UI, offrant une approche scientifique et mesurable pour améliorer les performances digitales. Les entreprises qui maîtrisent cette pratique bénéficient d’avantages concurrentiels significatifs : augmentation des taux de conversion, réduction des risques liés aux modifications et prise de décisions éclairées par la data, tout en favorisant la génération de nouveaux leads .

Cependant, la réussite de votre stratégie d’A/B testing dépend largement de la qualité de son implémentation et de l’expertise mobilisée pour l’analyser. Les enjeux techniques et méthodologiques nécessitent un accompagnement spécialisé pour éviter les écueils et maximiser le retour sur investissement.

Merci d’avoir lu notre article jusqu’à la fin ! 🙂

N’hésitez pas consulter nos services d’AB tests ou à nous contacter afin de demander votre audit ergonomique et UX gratuit ou planifier un échange avec nos experts etdiscuter de vos besoins spécifiques en optimisation de conversion.